Ο ΟΠΟΊΟΣ έχει εκδώσει νέες οδηγίες σχετικά με την ηθική και τη διακυβέρνηση μεγάλων πολυτροπικών μοντέλων (LMM) για την κατάλληλη χρήση τους για την προώθηση και την προστασία της υγείας των πληθυσμών. Τα LMM είναι ένας τύπος ταχέως αναπτυσσόμενου γενετικού υλικού τεχνητή νοημοσύνη Τεχνολογία (AI) που έχει πέντε ευρείες εφαρμογές για την υγεία in

1. Διάγνωση και κλινική φροντίδα, όπως απάντηση σε γραπτά ερωτήματα των ασθενών.

2. Χρήση καθοδηγούμενη από τον ασθενή, όπως για τη διερεύνηση συμπτωμάτων και θεραπεία.

3. Γραφεία και διοικητικά καθήκοντα, όπως η τεκμηρίωση και η περίληψη των επισκέψεων ασθενών στα ηλεκτρονικά αρχεία υγείας.

4. Ιατρική και νοσηλευτική εκπαίδευση, συμπεριλαμβανομένης της παροχής στους εκπαιδευόμενους προσομοιωμένων συναντήσεων ασθενών και.

5. Επιστημονική έρευνα και ανάπτυξη φαρμάκων, συμπεριλαμβανομένης της αναγνώρισης νέων ενώσεων.

However, these applications in healthcare run the risks of producing false, inaccurate, biased, or incomplete statements, which could harm people using such information in making health decisions. Furthermore, LMMs may be trained on data that are of poor quality or biased, whether by race, ethnicity, ancestry, sex, gender identity, or age. There are also broader risks to health systems, such as accessibility and affordability of the best performing LMMs. LMMs can also encourage ‘automation bias’ by health care professionals and patients, whereby errors are overlooked that would otherwise have been identified or difficult choices are improperly delegated to a LMM. LMMs, like other forms of AI, are also vulnerable to cybersecurity risks that could endanger patient information or the trustworthiness of these algorithms and the provision of health care more broadly.

Επομένως, για τη δημιουργία ασφαλών και αποτελεσματικών LMM, ο ΠΟΥ έχει κάνει συστάσεις για τις κυβερνήσεις και τους προγραμματιστές LMM.

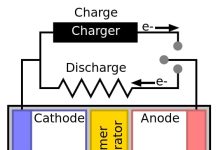

Οι κυβερνήσεις έχουν την πρωταρχική ευθύνη να θέσουν πρότυπα για την ανάπτυξη και την ανάπτυξη των LMM, καθώς και την ενσωμάτωση και χρήση τους για τη δημόσια υγεία και τους ιατρικούς σκοπούς. Οι κυβερνήσεις θα πρέπει να επενδύουν ή να παρέχουν μη κερδοσκοπική ή δημόσια υποδομή, συμπεριλαμβανομένης της υπολογιστικής ισχύος και των δημόσιων συνόλων δεδομένων, προσβάσιμες σε προγραμματιστές στον δημόσιο, ιδιωτικό και μη κερδοσκοπικό τομέα, που απαιτεί από τους χρήστες να τηρούν τις ηθικές αρχές και αξίες ανταλλαγή για πρόσβαση.

· Use laws, policies and regulations to ensure that LMMs and applications used in health care and medicine, irrespective of the risk or benefit associated with the AI technology, meet ethical obligations and human rights standards that affect, for example, a person’s dignity, autonomy or privacy.

· Αναθέστε μια υπάρχουσα ή νέα ρυθμιστική υπηρεσία για την αξιολόγηση και την έγκριση LMM και εφαρμογών που προορίζονται για χρήση στην υγειονομική περίθαλψη ή την ιατρική – εφόσον το επιτρέπουν οι πόροι.

· Εισαγωγή υποχρεωτικού ελέγχου μετά την κυκλοφορία και εκτιμήσεων επιπτώσεων, μεταξύ άλλων για την προστασία δεδομένων και τα ανθρώπινα δικαιώματα, από ανεξάρτητους τρίτους όταν ένα LMM αναπτύσσεται σε μεγάλη κλίμακα. Ο έλεγχος και οι εκτιμήσεις επιπτώσεων θα πρέπει να δημοσιεύονται

και θα πρέπει να περιλαμβάνει τα αποτελέσματα και τις επιπτώσεις που αναλύονται ανά τύπο χρήστη, συμπεριλαμβανομένων, για παράδειγμα, κατά ηλικία, φυλή ή αναπηρία.

· LMMs are designed not only by scientists and engineers. Potential users and all direct and indirect stakeholders, including medical providers, scientific researchers, health care professionals and patients, should be engaged from the early stages of AI development in structured, inclusive, transparent design and given opportunities to raise ethical issues, voice concerns and provide input for the AI application under consideration.

Τα LMM έχουν σχεδιαστεί για να εκτελούν καλά καθορισμένες εργασίες με την απαραίτητη ακρίβεια και αξιοπιστία για τη βελτίωση της ικανότητας των συστημάτων υγείας και την προώθηση των συμφερόντων των ασθενών. Οι προγραμματιστές θα πρέπει επίσης να είναι σε θέση να προβλέπουν και να κατανοούν πιθανά δευτερεύοντα αποτελέσματα.

***

πηγή:

ΠΟΥ 2024. Ηθική και διακυβέρνηση της τεχνητής νοημοσύνης για την υγεία: καθοδήγηση για μεγάλα πολυτροπικά μοντέλα. Διαθέσιμο στο https://iris.who.int/bitstream/handle/10665/375579/9789240084759-eng.pdf?sequence=1&isAllowed=y

***